Unter der Leitung des Max-Planck-Instituts für empirische Ästhetik (MPIEA) erforschte ein internationales, interdisziplinäres Team ob und wie Menschen ihren Emotionen durch Körpersprache Ausdruck verleihen. Fundamentale Bewegungskonzepte, die aus dem Körperinneren, an der Schnittstelle zwischen neuronaler Verbindung und Muskulatur und Gelenken stattfinden nennt sich Interozeption.

Frankfurt am Main, 02. Juli 2024. Wer oder was ich bin drückt sich durch die Art und weise wie wir uns bewegen aus. Was mich zu welchem Zeitpunkt geprägt hat, was in mir steckt, was aus mir spricht, ob inneres Verhalten, denken und fühlen mit dem äusseren Erscheinungsbild übereinstimmend sind oder eben nicht. Es ist Form von Kommunikation und Ausdruck. Diverse Autoren haben in der grossen Zeit der Psychoanalye vor mehr als 100 Jahren bereits das maximale Gegenstück entdeckt. Neurosen hemmen die Bewegungsfähigkeit bis hin zur kompletten Lähmung! Ein Widerstand leisten gegen so ziemlich alles was einem vor die Nase kommt ist Ausdruck von Neurosen die nie bekämpft wurden und sich somit intensiviert haben. Auf der anderen Seite steht die Produktivität, der Moment ab dem sich Motiv und Bewegung die Klinke in die Hand geben. Wie sehr muss mich etwas emotional bewegen, bis oder das mich ein Motiv in die Lage versetzt eine Handlung zu tun? Der Begriff dafür heisst Interozeption – und bedeutet, Körpersignale aus dem Inneren

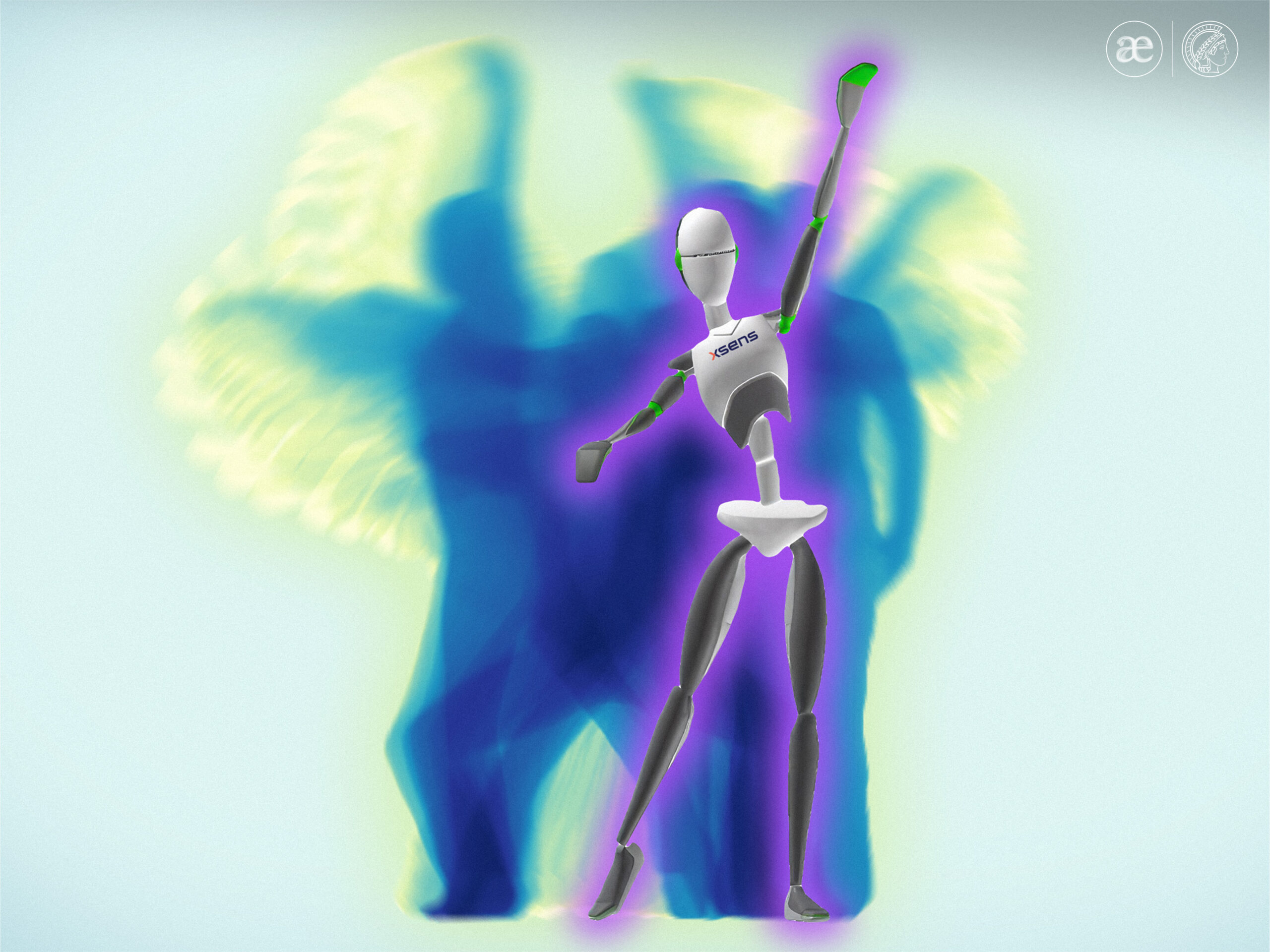

Eine professionelle Tänzerin wiederholte kurze Tanzchoreografien vor einem Greenscreen. Ihre Bewegungen wurden mit einem Ganzkörperanzug und einer Motion-Capture Aufgezeichnet. Die Aufgabe zur Studie war, mit dem Tanz Emotionen zum Ausdruck zu bringen. Wut. Zufriedenheit, Angst, Freude, Neutralität und Traurigkeit.

Auf diese Weise entstand ein Pilot-Tanz-Datensatz der Parameter wie Geschwindigkeit, Beschleunigung oder Kontraktion der Gliedmassen enthielt. Insgesamt konnten 12 kinematische Merkmale emotionaler Ganzkörperbewegungen extrahiert werden.

Bewegungstracking findet in den letzten Jahren in vielen Bereichen Anwendung, weil das objektive Erfassen von Bewegungsparametern Aufschluss über Intentionen, Gefühle und Gemütsverfassung von Personen geben kann. Diese Forschung braucht allerdings theoriebasierte Methodik, um aussagekräftige Schlussfolgerungen über erfasste Daten machen zu können.

„Diese Arbeit zeigt, wie künstlerische Praxis, Psychologie und Computerwissenschaften auf ideale Weise zusammenarbeiten können, um Methoden zur Erforschung der menschlichen Kognition zu erarbeiten“, sagt Andrés Fernández vom Max-Planck-Institut für Intelligente Systeme in Tübingen und Co-Erstautor der Arbeit.

Das Open-Source Softwarepaket Emokine ist über die Internetplattform ZENODO und GitHub frei verfügbar und kann auf alle Motion-Capture-Systeme übertragen werden.

Mit diesen frei verfügbaren digitalen Werkzeugen kann nicht nur der emotionale Ausdruck von Tänzern und Tänzerinnen und anderer KünstlerInnengruppen untersucht werden, sondern auch ganz alltägliche Bewegungen.

Die ForscherInnen hoffen nun, dass die von ihnen entwickelte Software EMOKINE in verschiedenen Bereichen Anwendung findet: in der experimentellen Psychologie, den affektiven Neurowissenschaften sowie auf dem Feld der Computer Vision, insbesondere in der KI-gestützten Auswertung von visuell geprägten Medien – ein Feld innerhalb der KI, das es Computern und Systemen ermöglicht, aussagefähige Informationen aus digitalen Bildern, Videos und anderen visuellen Eingaben zu gewinnen. EMOKINE hilft WissenschaftlerInnen die Frage zu beantworten, wie kinematische Parameter von Ganzkörperbewegungen BeobachterInnen verschiedene Absichten, Gefühle und mentale Zustände vermitteln.

Originalpublikation:

Christensen, J. F., Fernández, A., Smith, R. A., Michalareas, G., Yazdi, S. H. N., Farahi, et al., F., Schmidt E. M., Bahmanian, N., & Roig, G. (2024). EMOKINE: A Software Package and Computational Framework for Scaling Up the Creation of Highly Controlled Emotional Full-Body Movement Datasets. Behavior Research Methods. Advance online publication. https://doi.org/10.3758/s13428-024-02433-0

Weitere Informationen:

https://zenodo.org/records/7821844

https://github.com/andres-fr/emokine

Bildquelle: MPI für empirische Ästhetik / L. Kleber, Visualisierung Avatar: XSENS®

Bildbeschreibung Kern der Studie war die Frage, ob und wie Menschen ihre Emotionen durch Körpersprache ausdrücken.

Der Newsletter erscheint einmal pro Woche Freitags mit allen Inhalten der Woche

Schreibe einen Kommentar